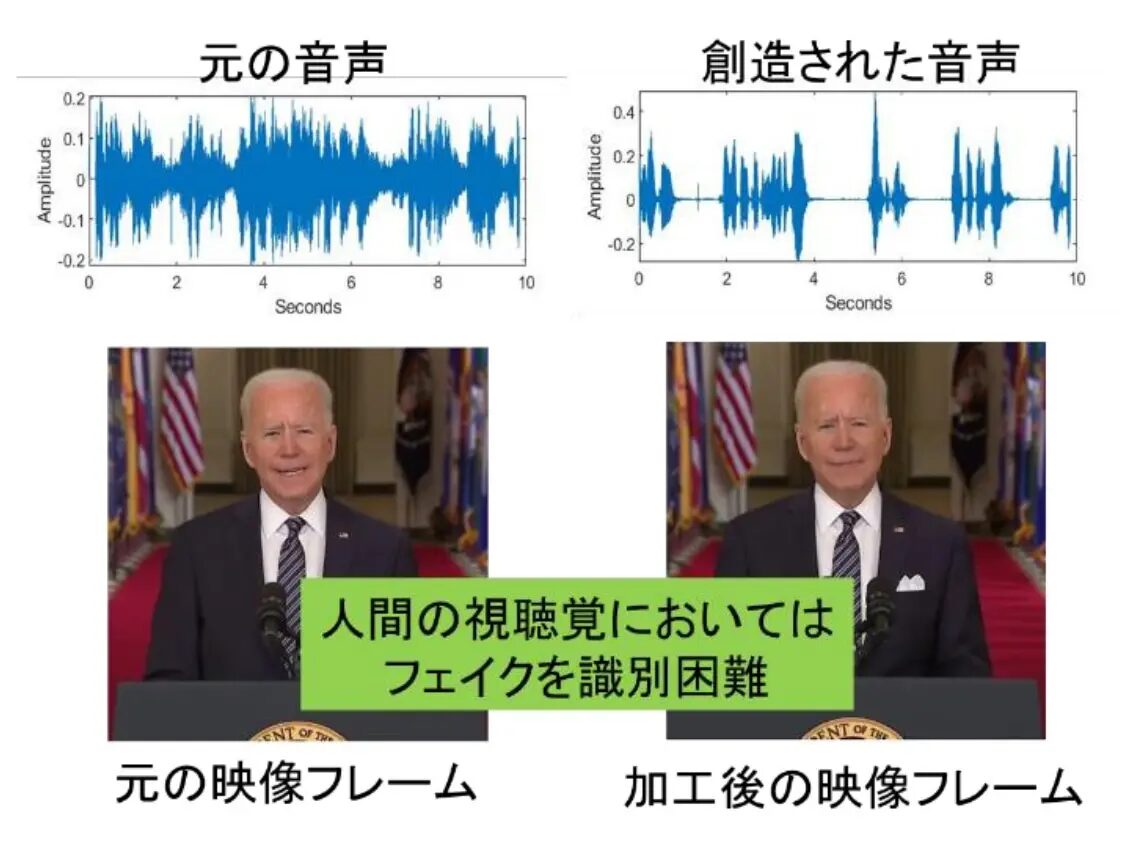

近年、生成AI技術の進化により、フェイク動画が急速に普及している。中でも、人物の動きや声を人工的に合成する「ディープフェイク」が話題だ。注意しながら視聴しても、本物と見分けがつかないほどリアルなものも多い。

ディープフェイク動画は、ネット上のアプリを使えば誰でも作成できる。その手軽さから、2020年末には約8万5,000件のフェイク動画が確認され、半年ごとに倍増している。

2022年には、ロシアのウクライナ侵攻に関連して、ゼレンスキー大統領が国民に投降を呼びかける偽動画が拡散され、フェイクニュースとして国際的な議論を呼んだ。

数年前までは、明らかに「AIが作った」と分かる動画ばかりで、ディープフェイクの精度もそれほど高くなかった。しかし、生成AI技術の目まぐるしい進化に伴い、今では肉眼で偽物と見分けることは限りなく不可能に近いものが増えている。

AI技術が悪用され、ディープフェイクポルノ問題が深刻化

AI技術の悪用によるわいせつな画像や動画「ディープフェイクポルノ」も国内外で問題視されている。興味本位で誰でも作成できてしまう簡単さが、問題を悪化させているのだ。

2024年には、中学生が同級生の写真を悪用して、わいせつなディープフェイク動画を作成するケースが報告されている。

ディープフェイク技術は、その特性上、ポルノ分野で悪用されやすい。顔や身体の特徴を精巧に合成できてしまうため、リアリティを追求する点で、わいせつなコンテンツの作成に利用されることが多いのだ。

被害は著名人だけでなく、一般人にも広がっている。卒業アルバムやSNS上の写真が無断で使用され、被害者がその事実を知らないまま拡散されるケースも少なくない。身に覚えのない動画が拡散され、精神的な苦痛を受けたり世間からの誤解を生んだりすることもある。

特に、顔写真や名前が記載されている卒業アルバムは個人情報の宝庫であり、ディープフェイク動画の素材として格好の標的となってしまっている。悪意ある同級生による不正利用にとどまらず、学校関係者や同級生が意図せず情報を漏らすケースや、家庭ゴミとして捨てられたアルバムが流出するケースも報告されている。

デジタル性暴力の相談件数は年々増加。被害者の低年齢化が進む

デジタル性暴力の相談件数は年々増加しており、10代の中高生による被害相談も跡をたたない。特に、SNSの普及により、未成年者が性暴力の標的となるケースが急増している。

韓国では、10代の学生が同級生や教師の写真を性的なディープフェイク画像に加工する事件が相次ぎ、学校や教育機関に深刻な影響を及ぼしている。こうした問題は、被害者が未成年である場合が多く、加害者もまた未成年であることが特徴的だ。

米国でも、ディープフェイクポルノの被害が広がっている。非営利団体「Thorn」の調査によれば、18歳未満の8人に1人が被害者を個人的に知っていると回答している(*1)。さらに、学校内でディープフェイク画像が拡散されるケースが増加しており、被害者の精神的な苦痛や更なる犯罪への影響が懸念されている。

2024年12月には、ペンシルベニア州の高校に通う2人の男子生徒が、学校の女子生徒の約半数のディープフェイク画像を作成したとして告発された。この事件では、学校内での画像拡散が深刻な問題となり、被害者のほとんどが10代の女子であった。

日本においても、デジタル性暴力の相談件数は増加傾向にあり、被害者の低年齢化が進んでいる。SNSやインターネットを背景とした性暴力の被害が、子どもたちの安全を脅かしている。

鳥取県が要望を提出。日本政府もディープフェイクポルノ対策に動き出す

海外では、韓国や米国がディープフェイクポルノに対する規制を強化している。韓国では所持や閲覧に刑事罰を科す法案が可決され、米国では複数の州が同意のない偽画像・動画の作成を禁じている。

諸外国の動きに比べ、日本の対応は遅れている。2025年3月24日、鳥取県で「性的ディープフェイク」を禁止する条例改正案が県議会の全会一致で可決されたが、全国的な法整備はまだ進んでいないのが現状だ。

条例の施行を受け、鳥取県の平井知事は、内閣府で三原こども政策担当大臣と面会し、被害者の救済策や厳正な取締りを求める要望を提出。平井知事は「子どもたちが一生の傷を負うことがないよう、適切な対策を講じる必要がある」と述べ、政府に対して迅速な対応を求めた。

これに対し、三原大臣は「非常に重要な問題であり、こども家庭庁でも議論を重ねていく」と述べ、政府としての対応を約束した。

時期を同じくして、国会でもディープフェイクポルノ問題への対応を本格化させている。衆院内閣委員会では、AI技術の利活用を目的とした新たな法案が可決されるとともに、ディープフェイクポルノ対策を強化する付帯決議が採択された。決議では、違法情報の削除依頼強化や被害者保護のための措置が求められており、政府の取り組みが注目されている。

ディープフェイクを見抜く技術も進化

ディープフェイク動画の悪用が社会問題として注目される一方で、その検知技術の進化が期待されている。

日本では、国立情報学研究所や東京大学などが高精度な検知システムを開発し、映像や音声の不自然な部分を自動的に判定する技術が進められている。フェイク動画の拡散を防ぎ、情報の信頼性を守る取り組みが強化されているのだ。

また、岡山大学では、動画に電子的な信号を埋め込み、加工の有無を判定する技術が研究されている。政府や企業の広報活動においても活用が期待されており、フェイク動画による誤情報の拡散を抑制する手段として注目されている。

検知技術の進化に伴い、ディープフェイク動画の真偽を見極める手段が整いつつあるが、技術だけに頼るのではなく、私たち自身の取り組みも重要だ。

例えば、一つの情報に頼らず、複数の信頼できる情報源を確認する習慣づけが有効である。また、情報を拡散する際にはその正確性を確認し、不適切な共有を避けることが賢明だ。

現在、日本ではディープフェイクを直接規制する法律が整備されておらず、法的対応が課題となっている。技術の進化と悪用の巧妙化に対抗するためには、ネットリテラシーの向上が求められる。情報の真偽を慎重に判断し、無責任な拡散をしないことが大切だ。

まとめ

問題視されがちなディープフェイク動画だが、技術そのものには社会的価値がある。例えば、医療分野では手術シミュレーションに活用され、患者の臓器や組織の動きをリアルに再現し、安全性と効率性の向上が図られている。また、教育分野では、歴史上の人物や遺跡を再現し、学びの体験を豊かにする試みが始まっている。

ディープフェイク問題の解決には、技術的な対応とともに、社会全体での取り組みが欠かせない。倫理的な利用を促し、悪用を防ぐための規制と教育が重要だ。技術と倫理の両立が進み、ディープフェイク問題の解決に向けた前進が期待されている。

注解・参考サイト

注解

(*1)Deepfake nudes and young people|Thorn Research

参考サイト

“性的ディープフェイク 子ども実在で法規制対象” 法務省見解|NHK

鳥取県知事「ディープフェイクポルノ」取締り 政府に要望|NHK

鳥取県 「性的ディープフェイク」禁止など 条例改正案が可決|NHK

フェイクコンテンツの真偽判定技術 ~AIによるウソ発見器|岡山大学

「ディープフェイク」見破る技術、日本でも開発進む…難問でAI特訓・音声に検知信号|讀賣新聞

丸山 瑞季

大学で国際コミュニケーション学を専攻。卒業後はデジタルマーケティングに携わり、現在は難聴児の子育てに奮闘しながら、楽しく生きることをモットーに在宅で働く。関心のあるテーマは、マインドフルネス、ダイバーシティ、心理学。趣味は、食べること、歩くこと、本を読むこと。( この人が書いた記事の一覧 )